https://docs.isaacsim.omniverse.nvidia.com/latest/sensors/index.html

Isaac Sim의 센서 시스템은 크게 6개 범주로 나뉘며, 물리 기반, RTX 기반, 카메라 기반, 그리고 실제 로봇에 적용 가능한 다양한 센서의 시뮬레이션을 지원합니다. 각 카테고리는 다음과 같은 목적으로 활용됩니다.

| 센서 분류 | 설명 | 주요 활용 |

|---|---|---|

| Camera Sensors | RGB/Depth 등 시각 센서 시뮬레이션 | 학습 데이터 수집, Sim-to-Real, SLAM |

| RTX Sensors | RTX 기반 Lidar/Radar 센서 | 거리, 속도, 반사 특성 정밀 감지 |

| Physics-Based Sensors | 물리 엔진 기반 센서 (IMU, 접촉 등) | 로봇 동작 및 힘, 충돌 감지 |

| PhysX SDK Sensors | PhysX SDK raycast 기반 경량 센서 | 단순 거리 감지, 성능 최적화용 |

| Camera and Depth Sensors | USD로 제공되는 실제 카메라 모델 | RealSense, ZED, Orbbec 등 디지털 트윈 |

| Non-Visual Sensors | 물리 기반 센서의 USD 자산 | IMU, Proximity, Contact 등 |

https://docs.isaacsim.omniverse.nvidia.com/latest/sensors/isaacsim_sensors_camera.html

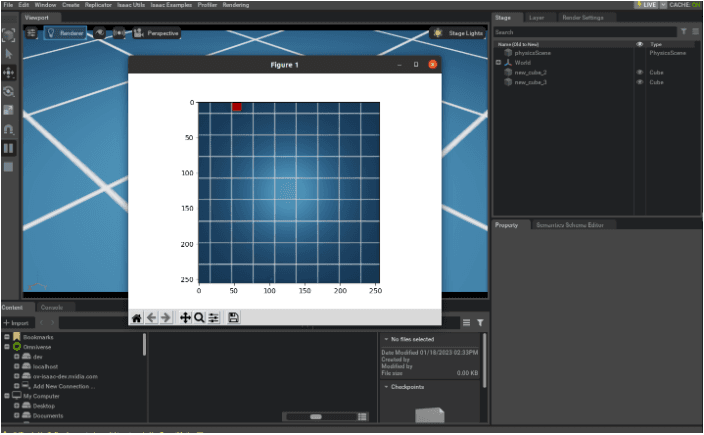

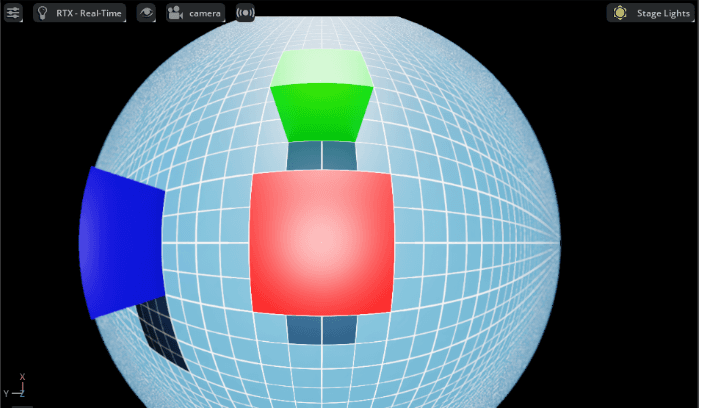

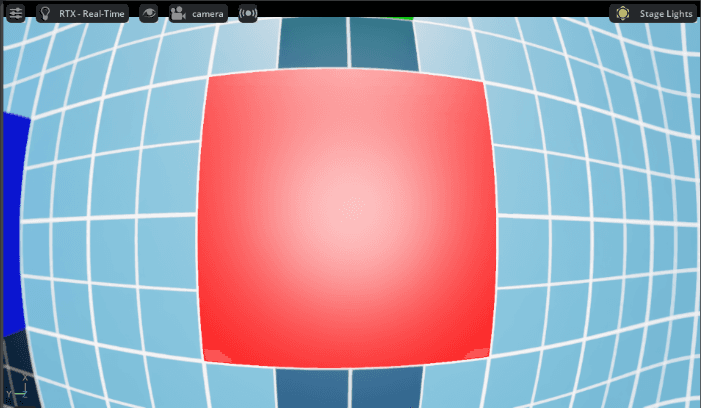

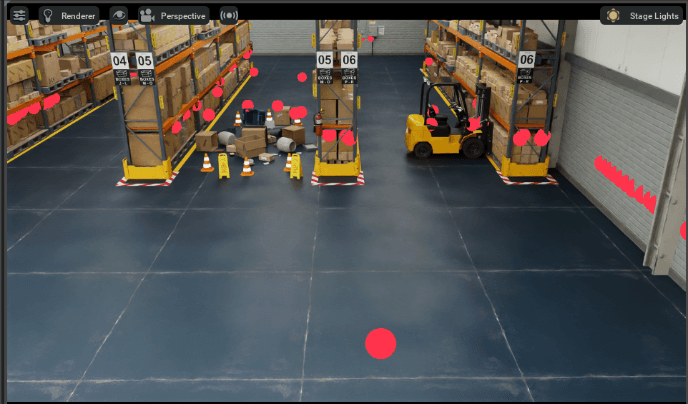

Isaac Sim에서 사용되는 기본적인 RGB/Depth 카메라는 실제 렌즈와 유사하게 시뮬레이션 가능하며, 다양한 Annotator 출력도 지원합니다.

Annotators란?

Isaac Sim에서 Annotator는 센서가 생성하는 이미지 외에 다양한 추가 Ground Truth 데이터 스트림을 자동 생성하는 기능입니다.

이 데이터는 머신러닝 학습, 로봇 인지, 검증 용도로 매우 유용합니다.

주요 Annotator 종류 및 설명:

| Annotator | 설명 | 활용 예시 |

|---|---|---|

| RGB | 일반 컬러 영상 | 이미지 분류, 인식 |

| Depth | 픽셀당 거리 정보 (Depth Map) | 거리 인식, SLAM |

| Normals | 표면 법선 벡터 | 포즈 추정, 재질 분석 |

| Motion Vectors | 프레임 간 이동 벡터 | 객체 추적, 모션 블러 |

| Instance ID | 오브젝트별 고유 ID | Instance Segmentation |

| Semantic ID | 클래스별 ID (ex: 사람=1, 박스=2) | Semantic Segmentation |

| 2D/3D BBox | 자동 경계 박스 | Object Detection |

| Optical Flow | 픽셀 단위 속도 벡터 | 로봇 비전, 자율주행 예측 |

Isaac Sim에서는 이 데이터를 .png, .json, .npy, ROS 메시지 등으로 출력 가능하며, Python API 또는 ActionGraph로 제어할 수 있습니다.

지원 기능:

활용 예:

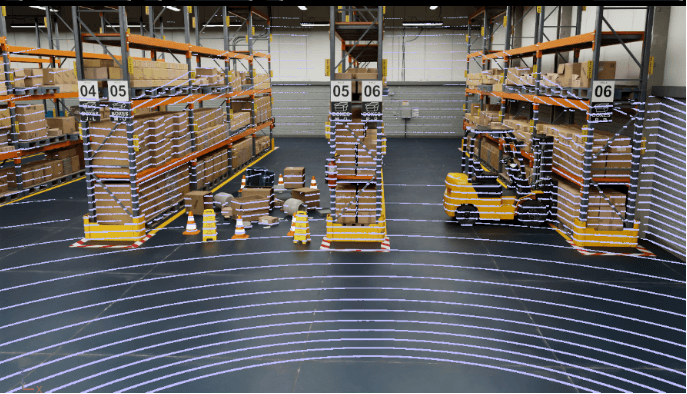

https://docs.isaacsim.omniverse.nvidia.com/latest/sensors/isaacsim_sensors_rtx.html

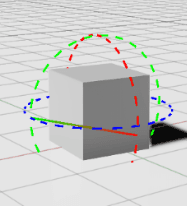

NVIDIA RTX 가속 기술을 활용한 고정밀 거리·속도 감지용 센서군입니다. 라이다(Lidar), 레이더(Radar), 시각적 Annotators로 구성되어 있습니다.

하위 구성:

활용 예:

시각적 재질 (Visual Sensor Materials)

RTX 센서가 감지하는 물체 표면의 시각적 속성 (예: 반사율, 흡수율 등)을 시뮬레이션합니다.

렌더링과 센서 반응 모두에 영향을 주며, 총 21개의 고정 재질(Material Type)이 제공됩니다.

| Index | Material Type | 설명 (예상) |

|---|---|---|

| 0 | Default | 기본 재질 |

| 1 | AsphaltStandard | 일반 아스팔트 도로 |

| 2 | AsphaltWeathered | 풍화된 아스팔트 |

| 3 | VegetationGrass | 잔디, 식생 |

| 4 | WaterStandard | 물 표면 |

| 5 | GlassStandard | 일반 유리 |

| 6 | FiberGlass | 섬유유리 |

| 7 | MetalAlloy | 합금 금속 |

| 8 | MetalAluminum | 알루미늄 |

| 9 | MetalAluminumOxidized | 산화된 알루미늄 |

| 10 | PlasticStandard | 일반 플라스틱 |

| 11 | RetroMarkings | 고반사 도로 마킹 |

| 12 | RetroSign | 고반사 교통 표지판 |

| 13 | RubberStandard | 고무 |

| 14 | SoilClay | 점토성 흙 |

| 15 | ConcreteRough | 거친 콘크리트 |

| 16 | ConcreteSmooth | 매끄러운 콘크리트 |

| 17 | OakTreeBark | 참나무 껍질 |

| 18 | FabricStandard | 천 |

| 19 | PlexiGlassStandard | 플렉시 유리 |

| 20 | MetalSilver | 은색 금속 |

| 31 | INVALID | 유효하지 않음 (예외 처리용) |

비시각적 재질 속성 (Non-Visual Sensor Material Properties)

렌더링에는 영향을 주지 않지만, RTX 센서의 감지 여부나 반사 강도에 영향을 주는 설정값입니다.

이를 통해 시뮬레이션 환경에서 특정 오브젝트가 감지되거나 무시되도록 설정할 수 있습니다.

사용 목적:

| 속성명 | 타입 | 설명 |

|---|---|---|

| no_sensor_hit | bool | True로 설정하면 RTX 센서에서 감지되지 않음 (센서 투명 처리) |

| sensor_visibility_boost | float | 기본값 1.0, 더 높게 설정 시 센서에서 더 잘 감지됨 (강한 반사 시뮬레이션) |

https://docs.isaacsim.omniverse.nvidia.com/latest/sensors/isaacsim_sensors_physics.html

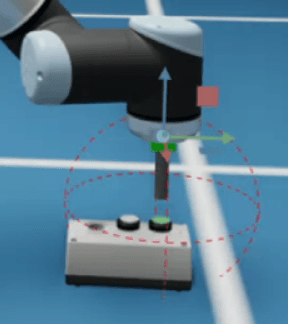

물리 엔진(PhysX) 상호작용을 기반으로 구현된 센서로, 로봇의 내부 상태나 외부 접촉 등을 감지합니다.

지원 센서 목록:

활용 예:

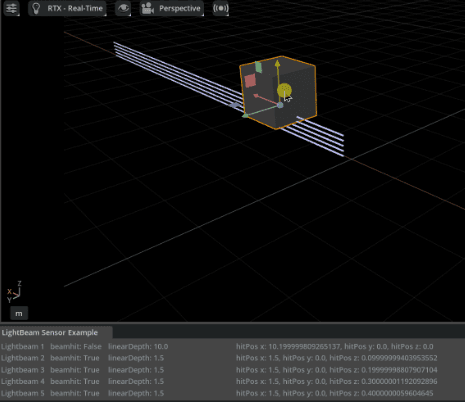

https://docs.isaacsim.omniverse.nvidia.com/latest/sensors/isaacsim_sensors_physx.html

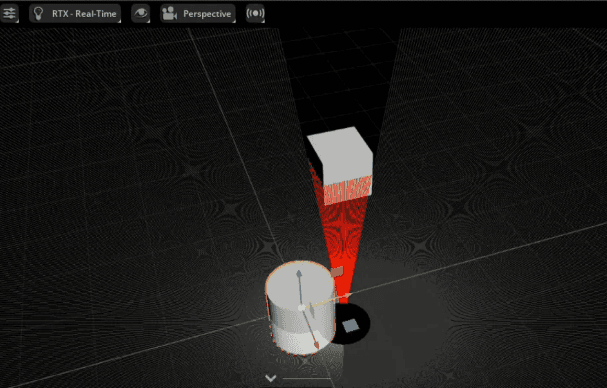

PhysX SDK의 Raycast 기능을 활용한 가벼운 거리 감지용 센서입니다.

지원 항목:

활용 예:

https://docs.isaacsim.omniverse.nvidia.com/latest/assets/usd_assets_camera_depth_sensors.html

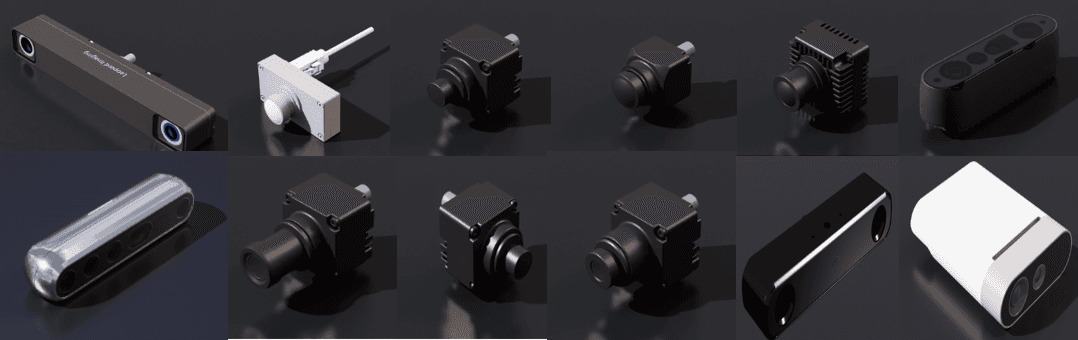

자주 쓰이는 실물 센서 모델을 기반으로 한 USD 형태의 카메라 및 Depth 센서 자산 모음입니다.

포함된 센서:

| 제조사 | 모델명 (제품명) | 유형 |

|---|---|---|

| Leopard Imaging | Hawk Stereo Camera (LI-AR0234CS-STEREO-GMSL2-30) | Stereo RGB + IMU |

| Owl Fisheye Camera (LI-AR0234CS-GMSL2-OWL) | Fisheye RGB Camera | |

| Sensing | SG2-AR0233C-5200-G2A-H100F1A | HDR 모노 카메라 |

| SG2-OX03CC-5200-GMSL2-H60YA | ADAS용 HDR 카메라 | |

| SG3-ISX031C-GMSL2F-H190XA | 3MP 자동차용 카메라 | |

| SG5-IMX490C-5300-GMSL2-H110SA | 5MP ADAS + Surround View | |

| SG8S-AR0820C-5300-G2A-H30YA | 4K HDR 자동차용 카메라 | |

| SG8S-AR0820C-5300-G2A-H60SA | 4K HDR 자동차용 카메라 | |

| SG8S-AR0820C-5300-G2A-H120YA | 4K HDR 자동차용 카메라 | |

| Intel | RealSense D455 | RGB + Depth + IMU |

| Orbbec | Gemini 2 | Active Stereo IR 기반 Depth |

| Femto Mega | RGB + Multi-mode Depth | |

| Gemini 335 | Depth | |

| Gemini 335L | Depth | |

| Stereolabs | ZED X | Stereo RGB + IMU |

활용 예:

https://docs.isaacsim.omniverse.nvidia.com/latest/assets/usd_assets_nonvisual_sensors.html

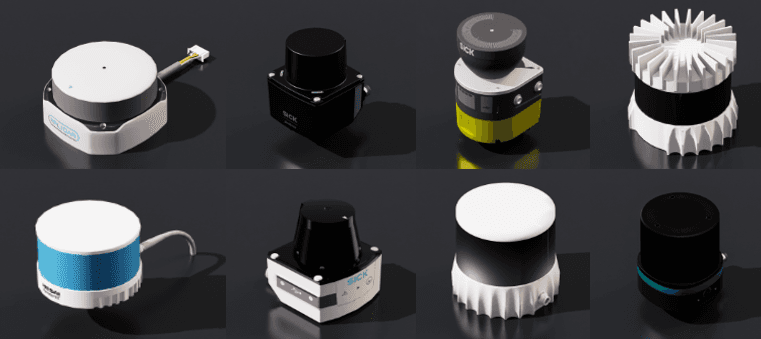

비시각 센서(IMU, Force, Contact 등)의 디지털 트윈용 자산 모음입니다.

자산 내용:

| 제조사 | 모델명 | 센서 유형 | 비고 |

|---|---|---|---|

| NVIDIA | Debug Rotary | Rotary Lidar (디버그용) | Mesh 없음 |

| Example Rotary 2D | 2D Rotary Lidar | Mesh 없음 | |

| Example Rotary | 3D Rotary Lidar | Mesh 없음 | |

| Example Solid State | Solid-State Lidar | Mesh 없음 | |

| Simple Example Solid State | 간이형 Solid-State Lidar | Mesh 없음 | |

| HESAI | XT32 SD10 | 32채널 360도 스핀형 Lidar | Certified |

| Ouster | OS0 | High-Res 3D Lidar (단거리) | 여러 구성 지원 |

| OS1 | High-Res 3D Lidar (중거리) | 여러 구성 지원 | |

| OS2 | High-Res 3D Lidar (장거리) | 여러 구성 지원 | |

| VLS 128 | 초고해상도 장거리 Lidar | ||

| SICK | microScan3 | 2D Safety Lidar | Certified |

| multiScan136 | 3D Lidar | Certified | |

| multiScan165 | 3D Lidar | Certified | |

| nanoScan3 | 초소형 Safety Lidar | Certified | |

| picoScan150 | 2D Industrial Lidar | Certified | |

| TiM781 | 2D Collision/Monitoring Lidar | Certified | |

| SLAMTEC | RPLIDAR S2E | 2D 스캐닝 Lidar | 저가형 |

| ZVISION | ML-30s+ | 단거리 Solid-State Automotive Lidar | Certified / Mesh 없음 |

| ML-Xs | 장거리 Solid-State Automotive Lidar | Certified / Mesh 없음 |

활용 예:

이 글 공유하기: